Lumière sur le son

Publié le 27/05/2014 à 23:00

-  14 min -

Modifié le 30/09/2022

par

Admin linflux

14 min -

Modifié le 30/09/2022

par

Admin linflux

Dans le cadre du festival annuel de musique éléctro des Nuits Sonores, coup de projecteur sur le son : quels sont les mécanismes physiques qui l'engendre ? Comment notre oreille le perçoit et de quelle façon l'interprète notre cerveau ? Un article pour en savoir davantage sur une science devenue, grâce à la révolution numérique, une véritable technique.

1) De l’air et des mégahertz

En 1700, le physicien Joseph Sauver crée le mot « acoustique », du verbe grec akouo*, « entendre ». La discipline est retenue par l’Académie des Sciences comme une branche de la physique. Tout est déjà là : malgré les arbres qui tombent dans la forêt, le son est d’abord un objet perçu par un sujet et une réalité physique. Si le débat a longtemps été farouche au sujet de la nature de la lumière (corpusculaire ou ondulatoire ?), le son, lui est clairement identifié comme une onde, et plus précisément une onde mécanique. Un objet vibre, que ce soit une corde de guitare, une cloche ou une membrane de haut-parleur, et cette vibration fait varier la pression de l’air avoisinant. Cette onde mécanique se déplace dans l’air, se propage, jusqu’à atteindre une oreille et mettre en mouvement le tympan.

Le nombre de vibrations par seconde, autrement dit la fréquence, va déterminer la hauteur du son : il sera plus aigu si la fréquence est élevée et plus grave si la fréquence est basse. Les fréquences sont mesurées en hertz (Hz), 1 Hz correspondant à une vibration par seconde. L’oreille humaine, celle qui nous intéresse au premier chef, est en général capable de percevoir les fréquences se situant entre 15 Hz et 20 000 Hz (soit 20 MHz). En-dessous de 15Hz se trouvent les fréquences de ce que l’on nomme les infrasons ; au-delà de 20 000 Hz, les vibrations sont celles des ultrasons. Attention à ne pas confondre la hauteur du son (plus ou moins grave ou aigu) avec l’importance du volume sonore, ou intensité : on peut écouter très fort des sons à fréquences plutôt basses, c’est-à-dire des sons graves, de même qu’on peut les écouter à un volume très bas. Si l’oreille humaine ne perçoit pas les infrasons et les ultrasons, ce n’est en aucun cas une question d’intensité. En physique, l’intensité se mesure en watt ou en pascals (puisqu’après tout il s’agit de pression sur un milieu !), mais en langage courant on utilise plutôt le décibel (dB). Finalement, un instrument de musique n’est rien de plus qu’un transformateur, ou transducteur, qui va transformer une énergie mécanique ou électrique en vibration mécanique.

Si l’on parle de vibration de l’air, on parle eh bien… de l’air. Contrairement à la lumière, le son ne se propage pas dans le vide mais bien dans un milieu qui peut propager la vibration, qu’il soit gazeux, solide, ou liquide. Ainsi, dans le silencieux 2001, l’odyssée de l’espace, de Stanley Kubrick, la physique est davantage respectée que dans Star Wars, de George Lucas, dans lequel on peut entendre les réacteurs des vaisseaux, les explosions, les tirs de laser… dans le vide. Dernier comparatif entre son et lumière : on connaît la vitesse de la lumière, théoriquement indépassable, mais qu’en est-il du son ? Si tous les sons voyagent à la même vitesse, et heureusement pour profiter de l’écoute d’un morceau aux multiples instruments, en revanche sa vitesse dépend du milieu qui transmet la vibration de sa source vers l’oreille. Le record est détenu par le diamant, avec une vitesse de plus de 15 000 mètres par seconde mais on parle en général d’une vitesse de 340m/s, qui est la vitesse de propagation dans l’atmosphère à température et pression normales. D’une manière générale, la vitesse du son est moins élevée dans les gaz que dans les liquides et les solides.

Les sons en 150 questions de Marie-Christine de La Souchère, Ellipses, 2013.

Tantôt perçus comme des bruits, tantôt comme de la musique, les sons baignent nos oreilles et font partie intégrante de notre environnement. Leur signification n’est pas la même pour le physicien, le musicien, le médecin ou l’homme de la rue. Comment décoder leur message ? A travers 150 courts questions et réponses, des plus classiques aux plus originales, l’ouvrage présente les sons dans toute leur diversité, sans formules ni équations, par le seul prisme de l’approche historique, de l’anecdote ou de l’expérience.

Musique et physique, de Chérif Zananiri, Ellipses, 2002.

Dans ce livre, la musique est étudiée du point de vue du physicien. L’auteur explique ce qu’est un son, la notion de gamme, puis présente les instruments à cordes, à vent et à percussion. A chaque fois, les études se font sur des exemples précis : la guitare, le piano, la flûte, la clarinette, le xylophone, l’orchestre symphonique voire la voix humaine.

Acoustique des instruments de musique, d’Antoine Chaigne et Jean Kergomard, Belin, 2013.

Quel est le rôle du biseau d’une flûte ? Comment se constitue le « timbre » d’un instrument qui nous permet de distinguer à coup sûr une trompette d’une clarinette ? A travers de nombreux exemples illustrés, cet ouvrage présente les bases nécessaires pour comprendre les phénomènes complexes à l’œuvre dans les instruments de musique. Il s’adresse aux chercheurs, aux étudiants, aux ingénieurs, mais aussi aux musiciens, facteurs et mélomanes qui souhaitent acquérir les fondements de l’acoustique musicale.

2) Psychoacoustique & Good Vibrations

Malgré son nom très « Blake et Mortimer », la psychoacoustique est une discipline tout à fait régulière de la psychophysique (pdf). Elle mêle acoustique, physiologie de l’audition et sciences cognitives. Le son part de sa source et est propagé jusqu’à l’auditeur, c’est là que la psychoacoustique prend le relais : la réaction de l’oreille humaine (le récepteur) aux sons (les stimulus) vers le cerveau et le système cognitif. C’est sur la base de la psychoacoustique que vont se monter et se développer les techniques électroacoustiques : on va chercher à produire techniquement ce qui va être perçu, sans se pencher sur les secteurs que l’homme ne perçoit pas.

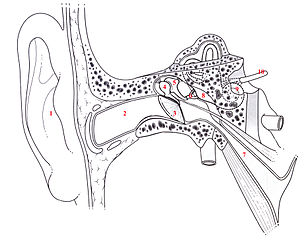

L’audiologie traditionnelle, ou acoustique médicale, repose sur l’oreille comme organe principal. Elle se divise en oreille externe (1 : pavillon ; 2 : conduit auditif externe), oreille moyenne (3 : tympan ; 4 : marteau ; 5 : enclume ; 6 : étrier ; 7 : trompe d’Eustache et 8 : mastoïde) et oreille interne (9 : cochlée ; 10 : nerf auditif).

Les sons que nous entendons sont le résultat de la vibration de l’air dans le conduit auditif jusqu’à faire vibrer le tympan. Les vibrations sont transmises par le marteau, l’enclume et l’étrier vers l’oreille interne. Les trompes d’Eustache relient l’oreille moyenne aux fosses nasales afin d’assurer une même pression des deux côtés du tympan. La cochlée est creuse, remplie de liquide et tapissée de cellules sensorielles disposées le long d’une membrane. La membrane et les cellules ciliées sont mises en mouvement par les vibrations, chaque cellule répondant à une certaine fréquence et amène donc le cerveau à différencier les hauteurs des sons. Le nerf auditif transmet finalement un signal nerveux depuis les cellules sensorielles vers le cerveau, ce dernier interprétant le signal comme un son donné, avec tous les biais que peut subir une interprétation : déformation, illusions, rôle de la mémoire, altération des zones cérébrales…

Au-delà de la connaissance pure, si la médecine s’est intéressée à l’oreille et au son, c’est que cela peut devenir une source de douleur, ou un moyen de soin. Les douleurs et les acouphènes ont déjà été traités dans cet autre Point d’Actu : Du bruit dans les oreilles. Vous y trouverez bourdonnement, sifflements d’oreille, hyperacousie et risques auditifs. A contrario, nous allons dire ici quelques mots sur les bienfaits du son et de la musique.

Les pythagoriciens pratiquaient déjà la purification musicale. Dans leur lignée, la musicothérapie a longtemps consisté à concevoir des programmes musicaux adaptés à chaque malade et à chaque effet désiré : la musique gaie devait entraîner le dépressif vers la gaieté, par exemple. On s’est légitimement interrogé sur les fondements scientifiques de ces théories… Dans les années 1970, psychothérapeutes et psychiatres intègrent les pratiques de la pédagogie musicale à celles des psychothérapies. Les questions d’esthétique et du simple plaisir sensoriel, hors du champ des représentations, sont par définition exclues des psychothérapies qui s’appuient sur les représentations. L’art-thérapie s’est développé en parallèle : la musique n’est plus alors simplement un média d’une thérapie extérieure, portée par le médecin, mais la musique a un pouvoir propre pour lequel elle est employée, au même titre qu’un médicament. Dans ce dernier domaine, l’essentiel du travail scientifique reste à faire.

L’oreille numérique : vue nouvelle sur la perception des sons de Roland Carrat, EDP Sciences, 2009.

L’oreille numérique : vue nouvelle sur la perception des sons de Roland Carrat, EDP Sciences, 2009.

La cochlée n’est-elle qu’un banal microphone ou s’agit-il d’un analyseur des sons qui nous agressent ? ou procède-t-elle différemment ? Par exemple sous la forme d’un convertisseur du signal acoustique en impulsions nerveuses sans décomposition préalable des sons ? Comment le message sonore est-il capté et codé avant d’être transmis au cerveau ? En quoi le numérique peut-il interférer dans ce mystérieux processus ? Jusqu’à ce jour a prévalue l’idée que l’oreille effectuait une analyse des sons complexes, comme sur un piano, mais ce postulat rencontre tellement d’objections qu’il est indispensable de concevoir un autre modèle. Les structures de l’oreille et la physiologie des fibres nerveuses sont pourtant particulièrement bien adaptées à l’analyse et à la transmission des informations sonores par l’intervention d’un échantillonnage des formes imprimées par les sons aux membranes élastiques de la cochlée. Les théories modernes de l’information et de la communication viennent fort heureusement à notre secours et éclairent d’un jour nouveau les multiples énigmes relevées dans les domaines de la psycho-acoustique, de la physiologie de l’audition et évidemment des troubles auditifs.

Musicophilia : la musique, le cerveau et nous d’Oliver Sacks, éditions du Seuil, 2008.

Musicophilia : la musique, le cerveau et nous d’Oliver Sacks, éditions du Seuil, 2008.

La musique peut nous émouvoir jusqu’au tréfonds de notre être, nous inciter à danser ou nous rendre tristes et nostalgiques. Quand on est un neurologue aussi compétent qu’Oliver Sacks comment peut-on comprendre et décrire ce pouvoir ? Plus d’aires cérébrales sont affectées au traitement de la musique qu’à celui du langage : l’homme est donc véritablement une espèce musicale. Bien des exemples le montrent, évoqués par Sacks avec la force et le talent qu’on lui connaît, depuis ce chirurgien frappé par la foudre qui devient soudain pianiste à l’âge de quarante-deux ans jusqu’au frère de Wittgenstein, pianiste et manchot, en passant par les handicapés mentaux mélomanes. La musique est médicalement bienfaisante : elle anime des parkinsoniens incapables de se mouvoir, apaise des patients atteints de la maladie d’Alzheimer et parvient même à restituer des souvenirs à certains amnésiques.

Tout savoir sur la musicothérapie de Richard Forestier, éditions Favre, 2011.

Tout savoir sur la musicothérapie de Richard Forestier, éditions Favre, 2011.

Ce livre débute par un prologue qui plonge le lecteur aux confins de la souffrance exprimée par la musique. Cette introduction a pour vocation de montrer dans quels cas la musicothérapie peut être salutaire pour une personne accablée par les circonstances de la vie. Puis, la première partie présente les fondements conceptuels, théoriques, méthodologiques et cliniques de la musicothérapie. La seconde est pratique. Des exercices, situations ou jeux sont développés de façon pragmatique et sous l’éclairage de l’attente médicale, du quotidien du musicothérapeute ou des bases qui caractérisent cette discipline. Spécialité de l’art-thérapie, la musicothérapie abordée ici reflète les enseignements universitaires de cette discipline.

La musicothérapie : la part oubliée de la personnalité de Rolando Benenzon, éditions De Boeck, Carrefour des psychothérapies, 2004.

Le Dr Rolando Benenzon développe dans ce livre une théorie de la personnalité centrée sur le principe de l’Iso (identité sonore). L’auteur parcourt largement le panorama de la musicothérapie en reprenant les concepts théoriques sur lesquels se fonde son modèle, les étapes techniques pour mener à bien une séance de musicothérapie et les diverses applications possibles, de la clinique musicothérapeutique individuelle à la prévention primaire. Ce livre de référence est destiné aux professionnels, psychologues, psychiatres, psychanalystes…

3) Electro-acoustique, numérique ou analogique (sampler ou sans reproche !)

« L’électro-acoustique », écrit Pierre Loyez, « est une science de compromis » entre phénomènes physiques et discipline psychoacoustique. Toute reproduction sonore est facteur d’émotion, de la prise du son à son écoute en passant par son amplification. C’est la difficulté des techniques de prise de son et de reproduction que d’être fidèles à la fois à la réalité physique de l’objet et à la perception particulière du sujet.

Pour enregistrer le son, c’est-à-dire la vibration particulière de l’air, le microphone reprend le principe, très simplifié, de l’oreille. La vibration de l’air fait vibrer le tympan, de même se trouve dans le micro un diaphragme qui sera plus ou moins affecté par les vibrations. Les variations de pression acoustique sont donc des variations de déplacement du diaphragme et ces variations sont ensuite transformées en variation de tensions électriques.

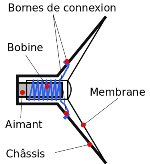

Une fois ces variations électriques enregistrées (sous format magnétique, ou numérique, par exemple), il faudra faire la transformation inverse pour que le son soit reproduit par des enceintes acoustiques. L’enceinte comprend un ou plusieurs haut-parleurs. Le haut-parleur reçoit l’énergie électrique, dont la puissance est modulée par l’amplificateur, et la transforme en énergie mécanique par les mouvements d’une bobine se déplaçant dans un aimant. Cette énergie mécanique est à son tour transformée en énergie acoustique par l’action de la membrane reliée à la bobine. Plus la membrane est lourde, plus sa fréquence de résonance est basse ; en revanche, pour les aigus, la membrane doit être petite, légère et rigide. C’est cela qui explique la spécialisation des haut-parleurs sur une enceinte, chacun destiné à reproduire les basses, les mediums et/ou les aigus.

Pour les questions de prise de son, de stockage et de reproduction s’opposent depuis la fin du siècle dernier les tenants de l’analogique et du numérique, visibles le plus souvent dans les oppositions disques vinyles contre disques compacts et fichiers numériques (DAT, MP3, FLAC…). De quoi s’agit-il exactement ? Sans rentrer dans les querelles d’experts, on peut s’appuyer sur les éléments physiques décrits ci-dessus pour avoir un aperçu des arguments.

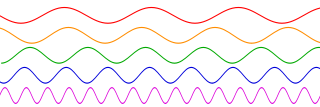

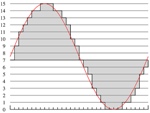

Le son est décrit en courbes (représentant les vibrations) dont la fréquence détermine la hauteur de ce son. Avec les techniques analogiques, la variation de la grandeur du signal varie de manière analogue à la source, d’où son nom ; dans ses variations, le passage d’une valeur à une autre se fait de façon continue, linéaire, et le nombre de valeur est infini ; la représentation d’un signal analogique qui varie est donc une courbe, une ligne continue avec des variations de hauteur. Dans le système numérique en revanche, il ne s’agit pas d’une valeur qui varie de façon continue dans le temps, mais de valeurs bien définies, en nombre limité, qui se succèdent dans le temps, un point après l’autre, une valeur après l’autre. Alors que le système analogique peut être représenté par une courbe continue, le système numérique est lui représenté par un histogramme. Sans même parler de compression du signal, on touche déjà au point de débat entre les tenants de chaque technologie : les valeurs bien définies du numérique rendent le stockage, le transport et la reproduction des données bien plus aisées (il n’y a pas de perte à la copie comme quand on dupliquait des cassettes, par exemple) ; mais cette création d’un signal non analogue à la source se fait par échantillonage, c’est-à-dire que l’on fait des mesures de valeur à intervalles très rapprochés, ce qui a pour conséquence, au moment de la diffusion du signal numérique en un son linéaire, de ne pas reconstituer le son intégralement mais seulement par paliers. Plus le nombre d’échantillons (ou samples) est élevé, plus on sera proche de la courbe initiale, mais cela implique aussi un dispositif technique plus important. Et puisque de bons dessins valent mieux que de longs discours, voyez ci-dessous les illustrations proposées par le site technicien-du-son.com pour illustrer la numérisation :

En rouge la courbe continue analogique, en gris et noir l’histogramme de la numérisation.

Plus le nombre d’échantillons est élevé, plus le rendu numérique s’approche de l’analogique.

La question étant évidemment de savoir si cette perte est effectivement audible par une oreille humaine et on rentre là, à nouveau, dans la perception subjective.

Précis d’électro-acoustique : prise de son et reproduction, de Dominique Fellot, EDP Sciences, 2007.

Précis d’électro-acoustique : prise de son et reproduction, de Dominique Fellot, EDP Sciences, 2007.

Ce précis expose en termes clairs et concis les connaissances essentielles en électro-acoustique. Il traite les bases essentielles de l’acoustique, les haut-parleurs, les principes des microphones, ou encore les techniques de prise de son. Quelques enceintes acoustiques remarquables sont décrites à la fin de l’ouvrage.

Construire ses enceintes acoustiques de René Besson, Dunod, 2006.

Construire ses enceintes acoustiques de René Besson, Dunod, 2006.

Pour les professionnels du son, les musiciens aguerris ou tout simplement les amateurs éclairés et exigeants, l’importance d’une bonne sonorisation n’est plus à démontrer. Après quelques rappels sur le son et la musique, cet ouvrage présente les principes de fonctionnement et la technologie des éléments centraux d’une enceinte acoustique : les haut-parleurs et les filtres. Pratique et très illustré, il vous permet de réaliser vos propres enceintes acoustiques.

Les magnétophones : enregistreurs numériques et analogiques de Claude Gendre, Dunod, 2005.

Les magnétophones : enregistreurs numériques et analogiques de Claude Gendre, Dunod, 2005.

Ce livre décrit les principes de base de ces appareils à travers l’histoire de l’enregistrement magnétique, depuis son invention par le Danois Valdemar Poulsen à la fin du XIXe siècle jusqu’aux nouveaux enregistreurs du XXIe siècle, ainsi que leur utilisation, la prise de son ou encore le montage.

Enfin, pour terminer, un rappel pour profiter de vos Nuits Sonores sans en faire pâtir vos voisins :

Nuisances sonores : prévention, protection, réglementation de Louise, Schriver-Mazzuoli, Dunod, 2007.

Nuisances sonores : prévention, protection, réglementation de Louise, Schriver-Mazzuoli, Dunod, 2007.

Cet ouvrage propose une synthèse des aspects physiques, sanitaires, techniques et réglementaires à prendre en compte pour analyser, prévenir et réduire les nuisances sonores…

Partager cet article